深度学习-李沐-第七节-ResNet

残差网络

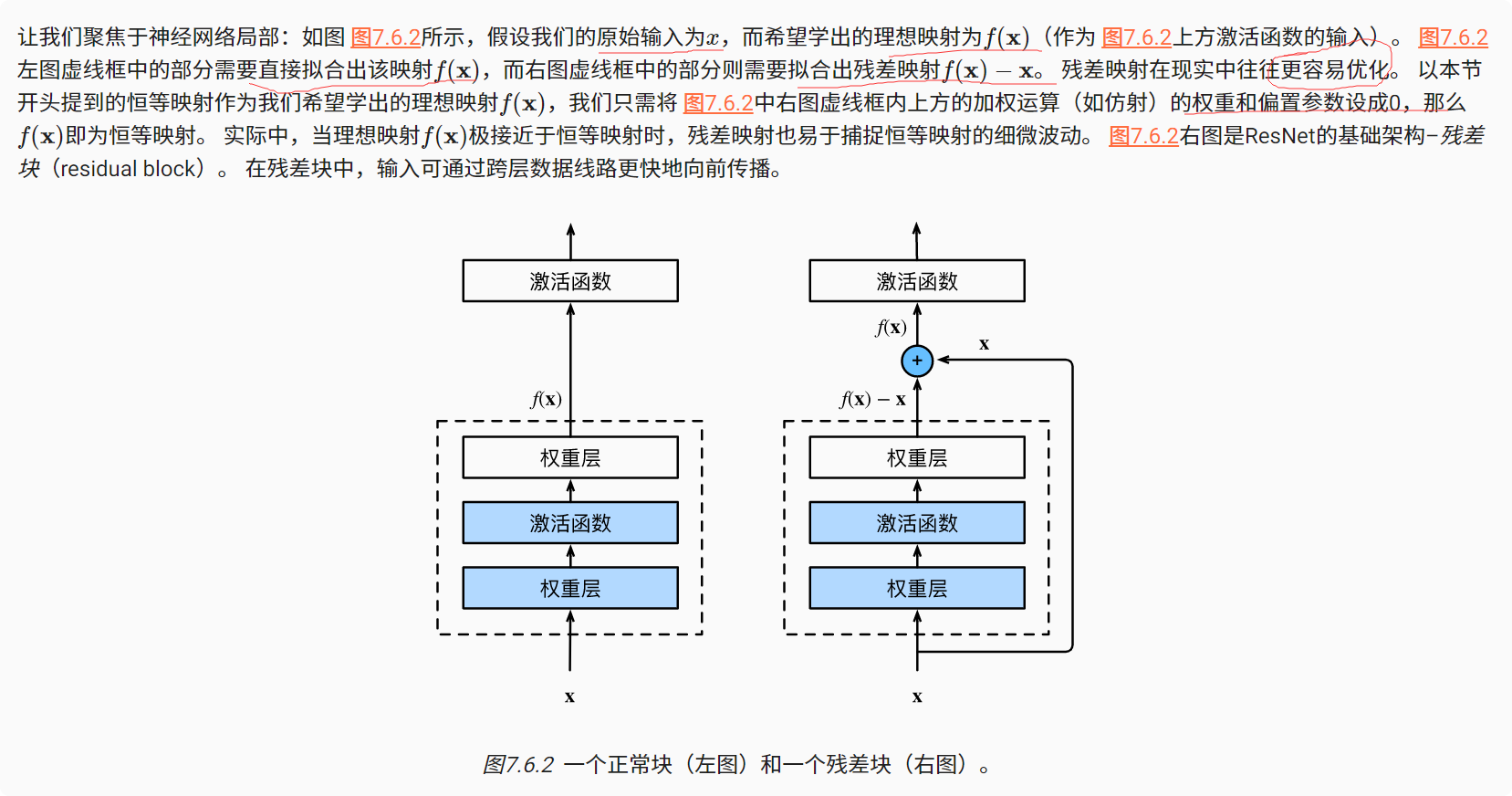

核心思想:每个附加层都应该更容易地包含原始函数作为其元素之一

残差块

ResNet沿用了VGG完整33的卷积层设计。 残差块里首先有2个有相同输出通道数的33卷积层。 每个卷积层后接一个批量规范化层和ReLU激活函数。 然后我们通过跨层数据通路,跳过这2个卷积运算,将输入直接加在最后的ReLU激活函数前。 这样的设计要求2个卷积层的输出与输入形状一样,从而使它们可以相加。 如果想改变通道数,就需要引入一个额外的1*1卷积层来将输入变换成需要的形状后再做相加运算。

残差块实现代码:

1 | import torch |

ResNet模型

ResNet的前两层跟之前介绍的GoogLeNet中的一样: 在输出通道数为64、步幅为2的77卷积层后,接步幅为2的33的最大汇聚层。 不同之处在于ResNet每个卷积层后增加了批量规范化层。

1 | b1 = nn.Sequential(nn.Conv2d(1, 64, kernel_size=7, stride=2, padding=3), |

GoogLeNet在后面接了4个由Inception块组成的模块。 ResNet则使用4个由残差块组成的模块,每个模块使用若干个同样输出通道数的残差块。 第一个模块的通道数同输入通道数一致。 由于之前已经使用了步幅为2的最大汇聚层,所以无须减小高和宽。 之后的每个模块在第一个残差块里将上一个模块的通道数翻倍,并将高和宽减半。

1 | def resnet_block(input_channels, num_channels, num_residuals, |

小结

{0}学习嵌套函数(nested function)是训练神经网络的理想情况。在深层神经网络中,学习另一层作为恒等映射(identity function)较容易(尽管这是一个极端情况)。

{0}残差映射可以更容易地学习同一函数,例如将权重层中的参数近似为零。

{0}利用残差块(residual blocks)可以训练出一个有效的深层神经网络:输入可以通过层间的残余连接更快地向前传播。

{0}残差网络(ResNet)对随后的深层神经网络设计产生了深远影响。

- 标题: 深度学习-李沐-第七节-ResNet

- 作者: moye

- 创建于 : 2022-08-16 15:00:46

- 更新于 : 2025-12-12 18:22:53

- 链接: https://www.kanes.top/2022/08/16/深度学习-李沐-第七节-ResNet/

- 版权声明: 本文章采用 CC BY-NC-SA 4.0 进行许可。

评论